AI Act, il testo approvato dal Coreper e i passaggi futuri

Il 2024 segna già un fondamentale passaggio nella disciplina normativa dell’AI.

Dopo l’accordo politico raggiunto alla fine dell’anno passato, infatti, lo scorso 2 febbraio il Comitato dei rappresentanti permanenti (Coreper) degli Stati membri dell’Unione ha approvato con voto unanime il Regolamento UE sull’intelligenza artificiale.

I principali contenuti del Regolamento AI

Nelle prossime settimane il testo dell’AI Act (o AIA) affronterà ancora l’esame di due Commissioni che ne analizzeranno rispettivamente gli impatti sul mercato interno e sulle libertà civili dei cittadini, per poi passare alla discussione nell’aula del Parlamento europeo.

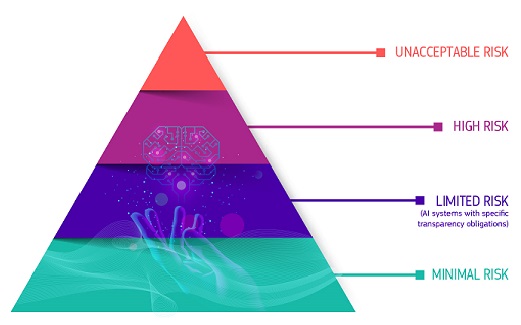

Sul piano dei contenuti, si confermano la preminenza di un approccio risk-based e la scelta di individuare 4 livelli di rischio per valutare i sistemi che impiegano l’intelligenza artificiale:

- minimo/inesistente;

- limitato;

- elevato;

- inaccettabile.

Particolari cautele sono previste in caso di general purpose AI (GPAI), categoria individuata in termini di “floating point operation” o FLOP, nella quale ad oggi rientrano ben pochi strumenti – tra cui GPT4 – ma di cui si prevede la forte espansione nel vicino futuro.

In concreto, i fornitori di sistemi ascritti alle categorie di rischio più elevato dovranno fornire informazioni dettagliate sulla qualità dei dati utilizzati e le modalità di “addestramento” applicate, oltre ad affrontare obblighi di mitigazione dei rischi particolarmente stringenti; ciò andrà implementato anche tramite attività di adversarial testing e, naturalmente, idonee misure di cybersecurity.

Per le pubbliche autorità europee si conferma il divieto di utilizzare tecniche di predictive policing o di riconoscimento biometrico in tempo reale. È tuttavia ammesso il ricorso alla crime analytics, ad esempio per individuare aree territoriali (ma non singole persone) che presentino un particolare rischio di attività criminali, con alcune eccezioni a salvaguardia delle libertà individuali.

Ulteriori novità sono rappresentate dall’istituzione di un AI Office presso la Commissione UE, che dovrà agevolare una governance condivisa in materia, nonché del Fundamental rights impact assessment, posto dall’art. 29 del Regolamento a carico di chiunque impieghi software basati sull’AI reputati “ad alto rischio”, imponendo loro più elevati requisiti di trasparenza e doveri di informazione verso gli utenti, insieme all’adozione di codici di condotta etica.

Sebbene a livello globale esistano già oltre 300 fonti normative – nonché numerosi standard tecnici – in ambito di Intelligenza Artificiale, il Regolamento comunitario assume su di sé l’onere di fornire definizioni univoche e regole condivise per la gestione di uno strumento ormai fondamentale, tanto per il mondo ICT quanto per l’umanità nel suo complesso.

Il voto finale del Parlamento europeo è previsto per il 24 aprile: fino ad allora, saranno ancora molti i nodi da sciogliere e le decisioni da prendere prima di poter dare una veste definitiva al nuovo AI Act.

A cura della Redazione